距离 2019 年第一季度结束还有 10 天,特斯拉说过会在一季度内量产的 Autopilot 硬件 3.0,依然不见踪影。

事实上,早在 2017 年 12 月 8 日举办的神经信息处理系统大会( NIPS ),马斯克就已经确认了特斯拉“正在打造世界上性能最高的消费级 AI 芯片”,而这款芯片将会搭载在 Autopilot 硬件 3.0 上,具备“全自动驾驶能力”。

时间再往回推,从 2015 年 11 月开始,马斯克已经在为特斯拉的自研芯片招兵买马,也就是说,特斯拉自研芯片的计划,起码已经推进了 40 个月了。想了解特斯拉自研芯片前 40 个月的发展,可以在公众号后台回复“自研”。

虽然硬件 3.0 还没有真正面世,但这并不影响我们根据此前已经披露的消息,在一定的程度上推测这款来自车企的芯片,到底有着怎样的能耐。

我们的结论是:这可能是第一次出现车企反攻 IT 界的情况。

特斯拉的自研芯片,与全世界为敌?

目前最详细的有关 Autopilot 硬件 3.0 爆料,来自于一位特斯拉论坛的大牛——Very Green。今年1月,他在特斯拉论坛中曝光了代号为“Turbo”的特斯拉深度学习自动驾驶芯片主要的硬件参数。

与硬件 2.0 和 2.5 的框架( SOC+GPU )类似,负责车机以及中控显示/操作的部分基于三星的猎户座7系列SOC打造,拥有最高八个 ARMCortex A72 内核以及最高 12 个 MaliT880 GPU 核心。

看到这里,相信不少了解手机芯片的朋友要开始吐槽了:7 系列 SOC 可是 2015 年的老古董,理论性能甚至比不上特斯拉硬件 2.0,特斯拉拿这种芯片做硬件 3.0,这不是开玩笑么?

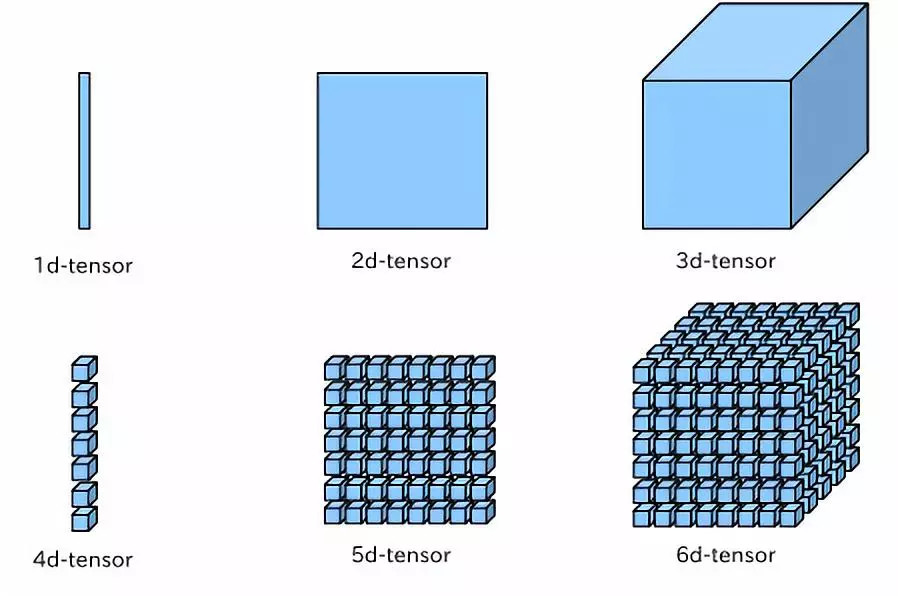

实际上,根据 Very Green 大佬的爆料,特斯拉自研芯片的核心部分,是与三星 SOC 通过 PCIE 总线连接的四个不知名芯片——代号叫 TRIP。而这四个 TRIP 芯片最重要的,就在于第一个字母 T——Tensor(张量)。

前排提示,下文可能会非常催眠。

这个张量不是做麻辣烫的,而是现代机器学习的基础。它的核心是一个数据容器,多数情况下,张量代表着数据的集合,根据维度的复杂程度,有1D、2D、3D张量,一直到无限 D 张量之分。

专门用来处理张量数据的芯片,我们把它叫做TPU——Tensor Processing Unit。TPU 也是目前最适合用于深度学习的芯片,甚至比GPU更加好使。

为什么呢?我们来举个例子——你是怎么分辨出一个人是男的还是女的?

一般情况下,穿着裙子的人是女性的可能性会更高,而穿着裤子的人则更有可能是男性。但在现实生活中,我们往往还需要结合很多个维度去判断——有没有喉结,有没有其他第二性征,声音的粗细程度,头发长与短,甚至脸型和四肢粗细等等。

不仅判断的维度很多,不同维度在大脑决策中所占的权重都是各不相同的——比如现在穿不穿裙子或者裤子,在男女性别判断这个问题上所占的维度已经不如以前高了,这些判断问题需要参考的不同维度(包括不同维度所占的权重,也算一个额外的维度),就是 N 个 D 的张量。

张量的问题解释清楚了,但为什么 TPU 在应对深度学习的时候比 GPU 更好用呢?

再举一个更简单的例子:10 件上衣和 10 条裤子两两搭配,一共会出现多少种方案?答案是10x10=100种,如果在加上 10 双鞋子,那就是10x10x10=1000 种。结合上面有关张量的解释来说就是:深度学习的过程,某种程度上就是在算乘法。

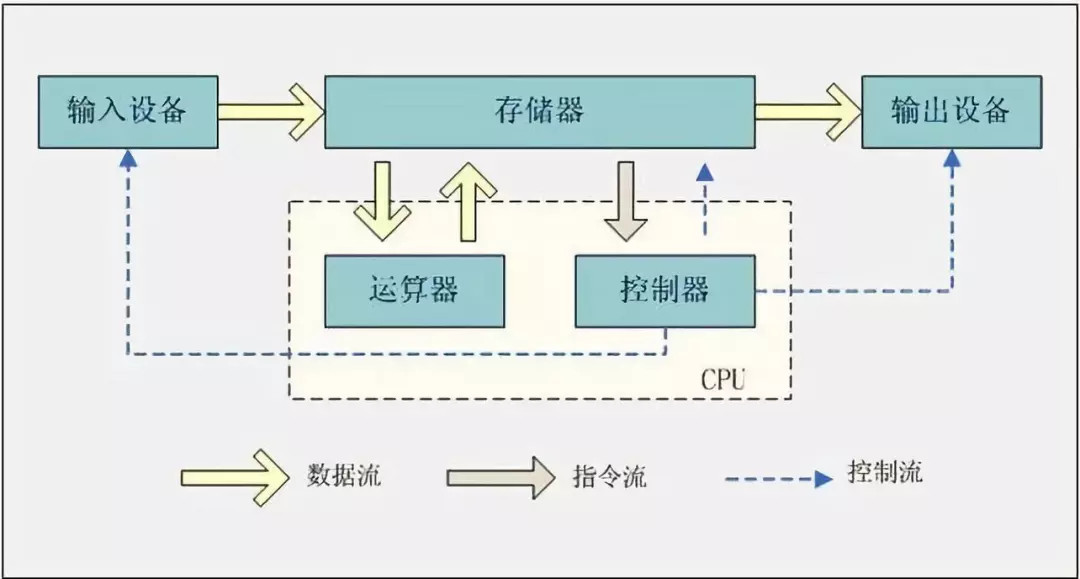

可同样是算乘法,GPU 和 CPU 在进行深度学习的时候,都存在瓶颈,这个瓶颈是有专业名词解释的——冯诺依曼瓶颈。

冯诺依曼瓶颈来源于冯诺依曼架构,这也是现代电子计算机的基本框架,由于冯诺依曼架构将处理核心的指令集和需要处理的数据统一放在一个缓存里面,所以在处理器性能飞速发展的今天,缓存的读写速度出现了跟不上处理器运行速度的瓶颈。

TPU 的性质正好不会出现冯诺依曼瓶颈——TPU 设计之初的目的就是要全心全意进行深度学习,而不是像 GPU 一样进行大量通用运算,所以 TPU 的核心不需要为各种各样的指令作适配,术业有专攻,讲的就是 TPU。

如果特斯拉真的研发出了自己的 TPU,那就意味着马斯克再一次站在了世界的对立面——这个星球上有在推进自动驾驶研发的汽车制造商,没有一家在使用 TPU 进行自动驾驶深度学习,更别说自己下场造芯片了。

社会你马哥,骚操作贼多。

还有谁在做 TPU?为什么要做 TPU?

没有人能够断定,具备先天优势的 TPU 一定会比 GPU 更适合自动驾驶,但这个世界上自动驾驶技术的领头羊,以及这个世界上自动驾驶技术的跳票王,都已经表现出了倾向于 TPU 的意思。

跳票王说的自然是马斯克——毕竟曾经的第一特粉,苹果公司联合创始人沃兹尼亚克都因为全自动驾驶功能连续跳票,说过“再也不相信马斯克有关自动驾驶的话了”。而领头羊,自然就是 Waymo,或者说,Waymo 背后的谷歌。

最早在 2006 年,谷歌就曾表示将会针对深度学习研发 ASIC 芯片(不了解 ASIC 芯片的朋友,可以公众号后台回复“参数陷阱”,或者在公众号菜单中点击“硬核时间”,即可获取更多未来汽车的幕后知识),到了 2013 年,谷歌表示其首款芯片已经正式流片(试产)。

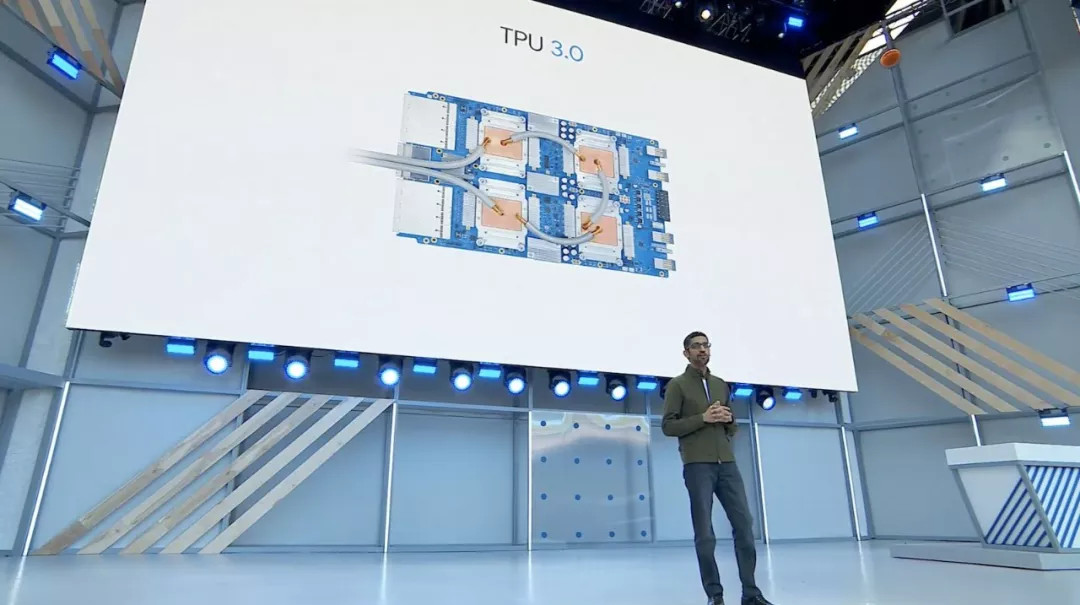

2015 年,谷歌发布 TPU 1.0,并同时发布针对 TPU 适配的深度学习框架 TensorFlow。但此时的 Waymo 还只是谷歌X实验室的一员,直到 2016 年 12 月才从谷歌独立出去,与谷歌同样重组至 Alphabet 旗下。

到了 2018 年的谷歌开发者大会,Waymo 正式宣布采用 TPU 3.0——这是谷歌最新一代的 TPU,宣称用 64 个 TPU 3.0 模块(256 个完整的 TPU 核心)搭建的服务器群就可以达到100Petaflops(Peta 表示千万亿次,flops表示浮点运算精度,1 petaflops表示一千万亿次浮点运算)的深度学习运算速度——作为对比,2016 年称霸世界超算的神威·太湖之光,深度学习运算速度也才 125 Petaflops。

另一个很重要的问题是——特斯拉做 TPU 的目的,真的只是为了自动驾驶吗?

“特斯拉的宏伟蓝图”,相信在马斯克写下这些文字的 2006 年,没有谁会相信他说的话——造车才是最赚钱的买卖,你居然说造车只是为推进能源革命服务?

可 13 年后的现在,马斯克已经走到了给这幅蓝图着色的最后一步,特斯拉也不仅代表着“可能是世界上最好的电动汽车(广告法还是要遵守的)”,而是“全套的新能源解决方案供应商”。

同样的情况,放在深度学习芯片上,也一样。举个栗子,什么样的电脑是性能最好的电脑?

标准千万个,通俗就一个——能流畅运行所有游戏的电脑,大多数场景下就是性能最好的电脑。

把问题变一下可以是这样的——什么样的深度学习芯片是性能最好的?按照目前的情况,答案应该是“能够应付全自动驾驶的深度学习芯片”。

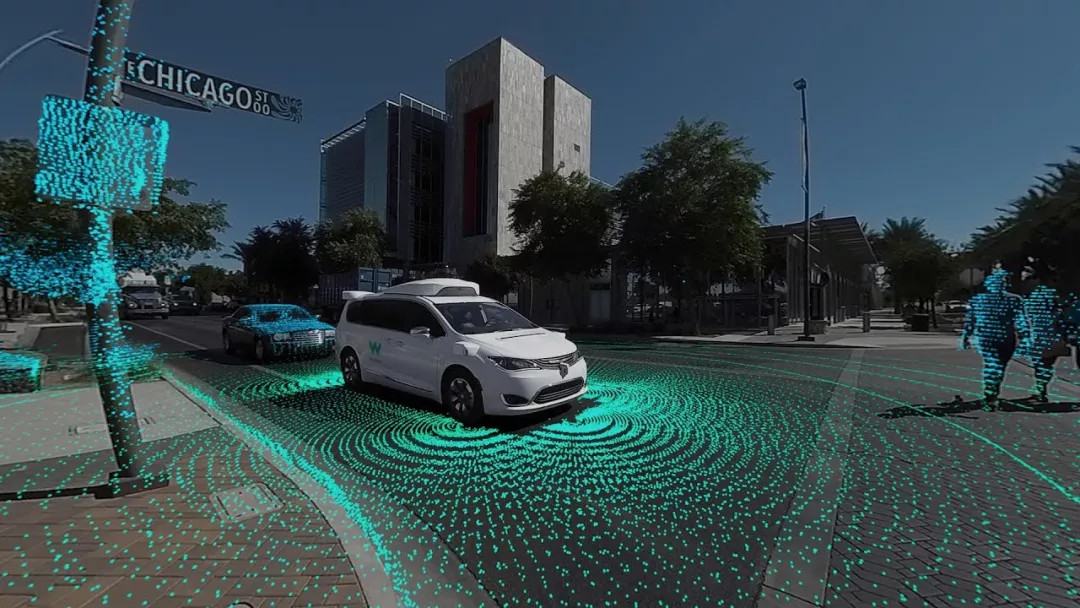

我们在上面讨论过张量的问题,“如何分辨一个人是男是女”,这是深度学习中一个很典型的例子,而这个场景,只是自动驾驶过程中一个极为细小的分支。在自动驾驶过程中,车辆不仅要分辨出前面的是不是人,是男的还是女的,还需要通过对动作和周围环境的分析,判断出 TA 正在做什么,下一步会做什么,而车辆本身应该做什么。

简单点总结就是——自动驾驶需要像人脑一样解构所感受到的整个世界,而游戏带来的性能要求正好相反——它要求计算机像人脑一样再现所感受到的整个世界。

也就是说,证明了全自动驾驶能力的深度学习芯片,可以像高性能计算机芯片一样,在各个不同的领域销售。

谷歌已经这样做了——甚至在应用于 Waymo 自动驾驶测试车之前,谷歌就已经将 TPU 服务器群通过云服务的方式,出租给全世界需要应用深度学习的个人、实验室,甚至企业。

特斯拉会这样做吗?马斯克会不会实现“世界上性能最高的消费级深度学习芯片”这个牛皮,然后让特斯拉成为一家新的芯片巨头?

等呗,谁让优秀的企业都爱跳票。

(完)

来源:第一电动网

作者:电动星球News蟹老板

本文地址:https://www.d1ev.com/kol/88534

本文由第一电动网大牛说作者撰写,他们为本文的真实性和中立性负责,观点仅代表个人,不代表第一电动网。本文版权归原创作者和第一电动网(www.d1ev.com)所有,如需转载需得到双方授权,同时务必注明来源和作者。

欢迎加入第一电动网大牛说作者,注册会员登录后即可在线投稿,请在会员资料留下QQ、手机、邮箱等联系方式,便于我们在第一时间与您沟通稿件,如有问题请发送邮件至 content@d1ev.com。

文中图片源自互联网,如有侵权请联系admin#d1ev.com(#替换成@)删除。